BERTアップデートは、Google検索において文脈理解の精度を飛躍的に高めた重要なアルゴリズム更新です。これにより、検索エンジンは単語単位の一致ではなく、文章全体の意味や意図を正確に把握できるようになりました。

導入後は、検索結果の関連性向上、多言語対応の精度改善、特集スニペットの品質向上など、検索体験に大きな変化が生まれています。本記事では、BERTアップデートの背景や仕組み、導入後の変化、そしてSEOにおける対応策までを体系的に解説します。

- BERTアップデートの概要と導入背景

- Google検索における位置づけと評価指標

- 仕組みの詳細とアルゴリズム変化

- SEO施策における対応ポイント

BERTアップデート(BERT Update)とは?

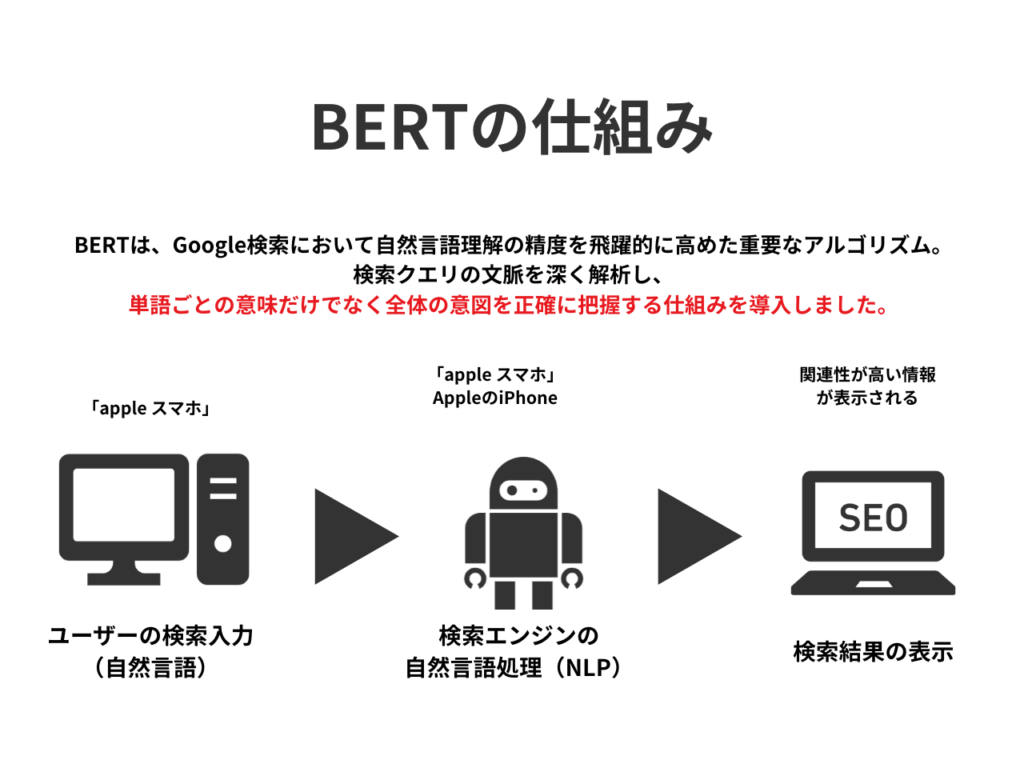

BERTアップデートは、Google検索において自然言語理解の精度を飛躍的に高めた重要なアルゴリズム変更です。特に、検索クエリの文脈を深く解析し、単語ごとの意味だけでなく全体の意図を正確に把握する仕組みを導入しました。

BERTは「Bidirectional Encoder Representations from Transformers」の略称で、日本語では「バート」と読みます。Googleの研究チームが開発した自然言語処理モデル群を指します。

BERTの革新性は、この構造を双方向に活用することで文脈理解を強化した点にあります。従来の言語モデルは文の一方向だけを参照することが多く、意味の把握に限界がありました。

2019 年に導入した BERT は、自然言語理解における大きな飛躍であり、“単語の組み合わせ” がさまざまな “意味” や “意図” をどのように表現しているかを理解するために活用されています。BERT は、個々の単語に一致するコンテンツを単に検索するのではなく、単語の組み合わせが複雑な概念をどのように表現しているかを理解できます。

引用元:Google 検索を支える AI 技術|GoogleJapan BLOG

しかしBERTは、対象単語の左右両側の情報を同時に取り込み、より精密な言語表現を生成します。これにより、検索クエリの解釈精度が格段に高まり、Google検索の進化を支える基盤技術として位置付けられています。

2. 導入の背景

BERT導入以前の自然言語処理モデルは、単方向性の学習に依存し、文脈を深く理解することが難しいという課題がありました。多くのモデルは大量のラベル付きデータを必要としますが、現実には数千から数十万件程度しか存在せず、学習データ不足が性能向上の障壁になっていました。

自然言語処理(NLP)における最大の課題の一つは、学習データの不足です。NLPは多様なタスクを含む広範な分野であるため、ほとんどのタスク特化型データセットには、数千から数十万件程度の人手によるラベル付き学習データしか含まれていません。しかし、現代のディープラーニングを用いたNLPモデルは、はるかに大規模なデータを活用することで性能が向上し、数百万から数十億件規模のアノテーション付き学習データで訓練することで精度が高まります。

引用元:Open Sourcing BERT: State-of-the-Art Pre-training for Natural Language Processin|Google Research

この制約を克服するため、研究者たちはWeb上の膨大なラベルなしテキストを活用した事前学習(Pre-training)に注目します。BERTは、この事前学習を用いて深い双方向表現を獲得し、少量のタスク固有データで高い性能を発揮できるモデルとして設計されました。

その背景には、自然言語処理の精度向上だけでなく、検索クエリの意図解釈精度を飛躍的に高め、ユーザーが求める情報への到達を容易にするというGoogle検索の戦略的目的があります。

3. 導入後の流れ

BERTは2018年に発表され、同年11月にはソースコードと事前学習済みモデルが公開されました。その革新性は瞬く間に学術界と業界に広まり、翌年には150件を超える研究がBERTを基盤として展開されました。

Google検索には2019年10月に米国内の英語クエリで初導入され、約10%の検索結果に影響を与えました。さらに2019年12月には70以上の言語に拡大し、2020年には英語ベースのほぼ全クエリに適用されるまで進化しています。

Google previously noted that BERT affected 10% of search queries for the English language rollout in the United States. It’s possible that BERT may affect similar amounts of search queries globally.

引用元:Google’s BERT Rolls Out Worldwide|SearchEngineJournal

この普及の速さは、BERTが単なる研究成果に留まらず、実用的かつ高い汎用性を持つ技術であることを証明しました。導入後もBERTは継続的に改良され、Google検索の基盤技術として重要な役割を担い続けています。

Google検索の歴史上での位置づけ

BERTは、Google検索アルゴリズムの進化の中でも特に大きな転換点となった技術です。発表当時、自然言語理解分野の主要なベンチマークで最先端の性能を達成し、その成果は検索結果の質向上に直結しました。

BERTの登場は、単語一致中心だった検索から、文脈を理解した検索へと移行するきっかけとなり、ユーザー体験を根本から変えています。

BERTが達成した主な指標改善は以下の通りです。

| 評価指標 | 概要 | BERT導入後の スコア | 改善幅 (絶対値) |

|---|---|---|---|

| GLUE | 複数の自然言語理解タスクの総合評価 | 80.5% | +7.7% |

| MultiNLI | 文間の含意関係判定 | 86.7% | +4.6% |

| SQuAD v1.1 F1 | 質問応答(答えあり)精度 | 93.2 | +1.5 |

| SQuAD v2.0 F1 | 質問応答(答えなし含む)精度 | 83.1 | +5.1 |

これらの成果は、Googleが検索クエリの意味をより正確に捉え、適切なページを提示する能力を向上させたことを示しています。特に英語検索での初期導入時には、全検索クエリの約10%に影響を与えたと報告されており、その影響範囲の広さが際立ちます。

また、BERTはその後も多言語対応を進め、英語以外の検索でも関連性の高い結果を提供できるようになりました。これにより、検索体験の質は世界規模で底上げされ、Google検索の精度向上の象徴的存在となっています。

BERTアップデートによる仕組みの変更

BERTは、Google検索における自然言語理解の精度を飛躍的に高めるため、従来モデルとは異なる複数の革新的仕組みを採用しました。これらの要素が組み合わさることで、検索クエリの文脈理解や意図推定の精度が向上し、関連性の高い検索結果提供が可能となっています。主な変更点は次の5つです。

- 双方向Transformerアーキテクチャの採用

- Masked Language Model(MLM)の採用

- Next Sentence Prediction(NSP)の導入

- WordPieceトークン化の利用

- 事前学習とファインチューニングの二段階構造

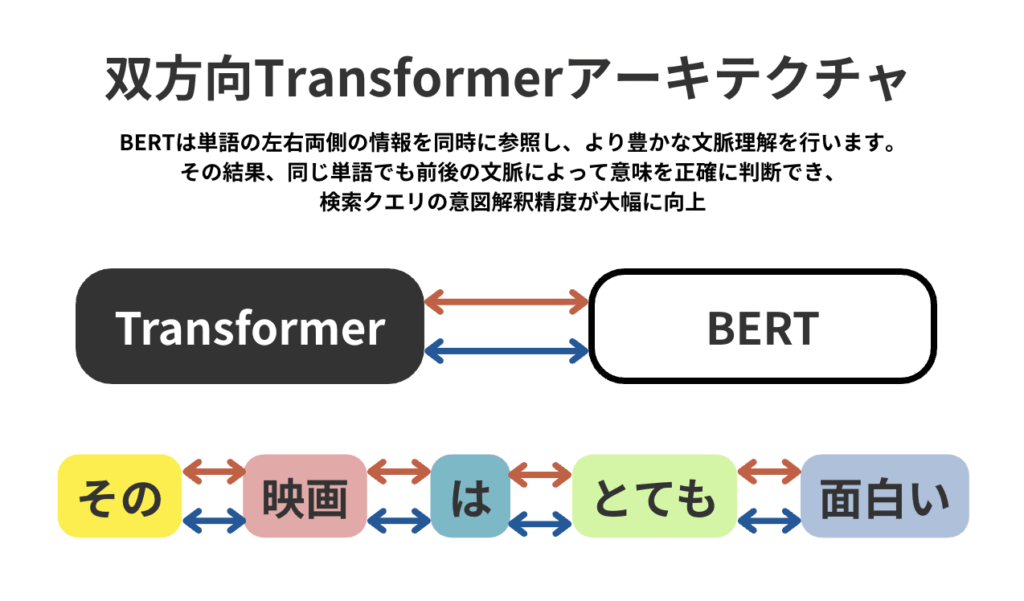

仕組み①|双方向Transformerアーキテクチャ

BERTは、文章の意味を理解するために「Transformer」という仕組みを双方向に活用します。Transformerは自己注意機構(Self-Attention)を使い、文中の全ての単語同士の関係を同時に把握できる構造です。

BERTは、すべての層において左右両方のコンテキストを統合的に条件付けすることで、ラベルなしテキストから深層双方向表現を事前学習するように設計されています。

引用元:BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding|GoogleResearch

従来のモデルは、左から右、または右から左のように片方向だけで文章を解析していました。これでは文全体の意味を正確に理解するのが難しく、特に複雑な文章やあいまいな表現で限界がありました。

BERTは単語の左右両側の情報を同時に参照し、より豊かな文脈理解を行います。その結果、同じ単語でも前後の文脈によって意味を正確に判断でき、検索クエリの意図解釈精度が大幅に向上します。特に、多義語や複雑な文構造の解釈に強く、関連性の高い検索結果を返すことにつながります。

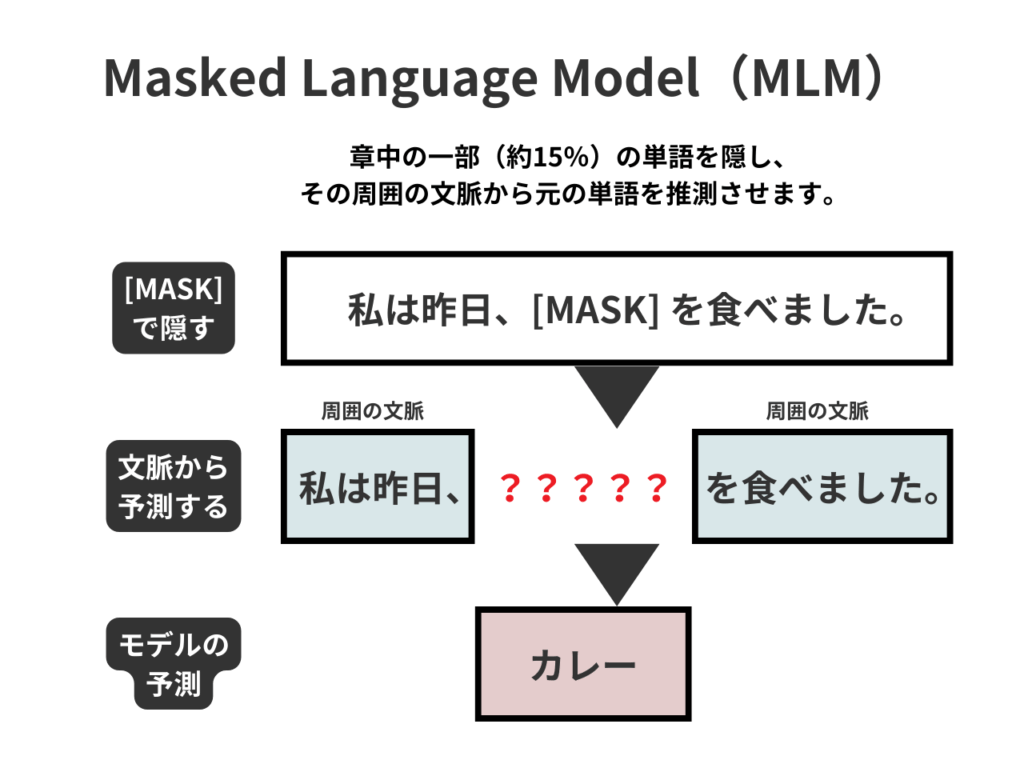

仕組み②|Masked Language Model(MLM)

MLM(Masked Language Model)は、BERTの事前学習で中心的な役割を果たす手法です。文章中の一部(約15%)の単語を隠し、その周囲の文脈から元の単語を推測させます。

隠された単語のうち、80%は[MASK]という特殊トークンに置き換えられ、10%はランダムな別の単語に置き換え、残りの10%はそのまま残します。

このようにランダム性を持たせることで、モデルは単純なパターン記憶ではなく、文全体の意味を捉える訓練ができます。

この仕組みによって、BERTは文章を一方向だけで読む制限から解放され、両方向の情報を使って意味を推測できます。検索においては、クエリの一部があいまいだったり、省略されていても、ユーザーの意図を正しく推測し、適切な結果を返す力が高まりました。

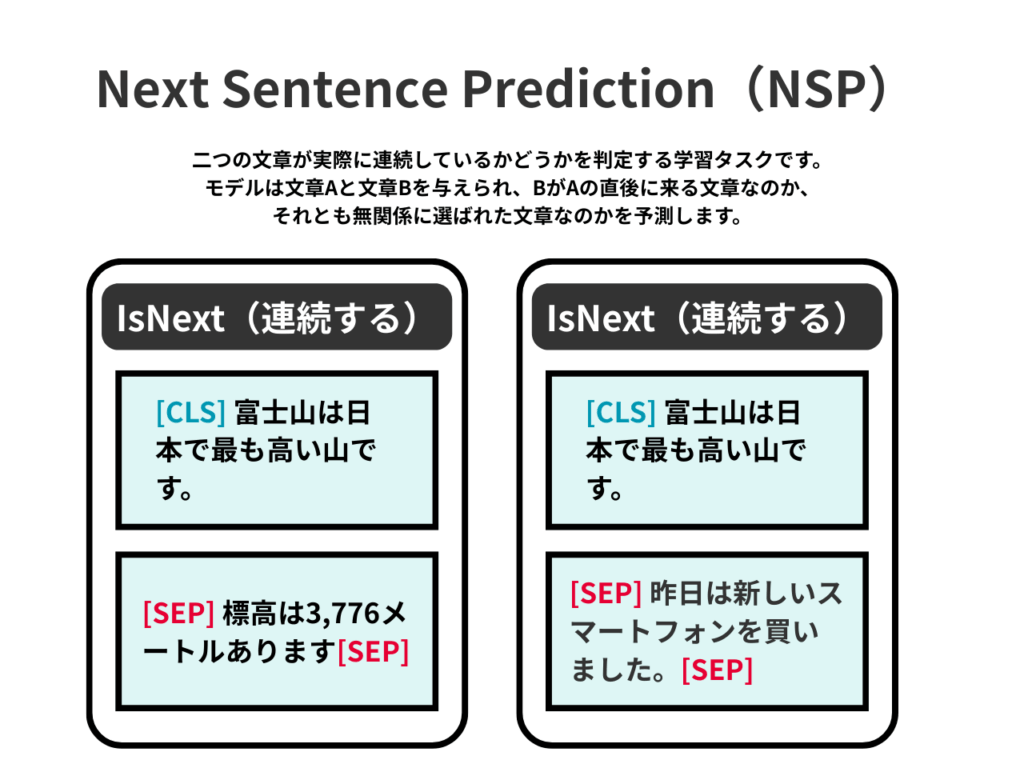

仕組み③|Next Sentence Prediction(NSP)

NSP(Next Sentence Prediction)は、二つの文章が実際に連続しているかどうかを判定する学習タスクです。モデルは文章Aと文章Bを与えられ、BがAの直後に来る文章なのか、それとも無関係に選ばれた文章なのかを予測します。

このとき、文章全体の先頭には[CLS]トークン、二つの文章の間には[SEP]トークンを挿入します。これにより、BERTは文と文のつながりや論理構造を把握できるようになります。

検索への応用では、質問文と回答文、記事タイトルと本文などの関連性を高精度で判断できます。その結果、ユーザーが求める答えや情報に直結するページを上位表示しやすくなり、検索体験の質を向上させます。

仕組み④|WordPieceトークン化

BERTは単語を分割する際に「WordPiece」という手法を使います。これは、未知の単語を既知の「サブワード」に分解し、語彙数を約3万語に抑えつつ、できるだけ多くの単語を表現できるようにする方法です。

例えば、「unbelievable」という単語は「un」「##believ」「##able」という単位に分割されます。こうすることで、全く新しい単語が出てきても、その一部から意味を推測できるようになります。

さらに「Whole Word Masking」という改良により、単語全体をまとめてマスクすることで、より自然な文脈理解を可能にしました。これにより、専門用語や造語を含む検索クエリでも、高い精度で意図を理解できるようになります。

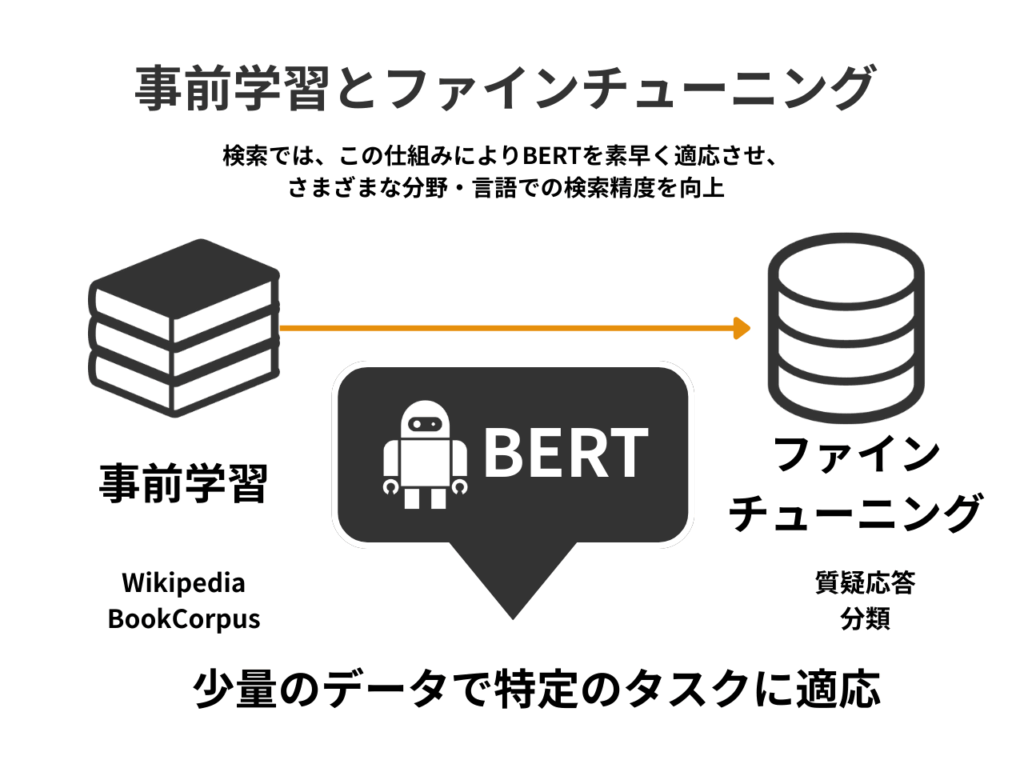

仕組み⑤|事前学習とファインチューニング

BERTの学習は「事前学習」と「ファインチューニング」の二段階で行われます。事前学習では、WikipediaやBookCorpusなど大規模なテキストを使い、言語全般の知識やパターンを学びます。この段階で膨大な計算資源を必要としますが、一度学習すればさまざまなタスクに使い回せます。

次に、質問応答や分類といった特定の目的に合わせてファインチューニングを行います。これは少量のデータで済み、短期間で高精度なモデルを構築できます。

検索では、この仕組みによりBERTを素早く適応させ、さまざまな分野・言語での検索精度を向上できます。例えば医療や法律といった専門分野向けにも、短時間で最適化が可能です。

BERTアップデートが引き起こしたGoogle検索アルゴリズムの変化

BERTの導入は、Google検索における自然言語処理の質を根本から変えました。検索クエリの意図理解や結果の関連性、多言語対応の精度が大幅に向上し、特集スニペットの表示品質にも影響を与えています。主な変化は次の4点です。

- 検索クエリの意図理解の深化

- 検索結果の関連性の向上

- 多言語検索への影響

- 強調スニペットの改善

変化①|検索意図の理解がより精緻に

BERTは文章を前後から同時に読み取り、単語の意味を文全体の流れの中で理解できます。従来の検索アルゴリズムは、単語の並びや前後数語しか参照できず、複雑な質問やあいまいな表現では正確な意図をくみ取るのが難しいという課題がありました。

BERTの導入後は、「to」と「for」のように意味が似ている単語でも、文脈によって使い分けを判断できるようになりました。これにより、長文や会話調の質問にも柔軟に対応可能になり、FAQ型検索や音声検索の精度が大きく向上しています。

例えば「明日東京から大阪まで安く行く方法を知りたい」という自然な文章でも、目的・条件・移動手段といった要素を正しく抽出し、より適切な結果を提示できます。

変化②|関連性の高い検索結果の提供

従来の検索はキーワード一致度を重視しており、言葉が完全一致していないと関連コンテンツが評価されにくい傾向がありました。BERTは文章全体の意味や意図を理解した上でマッチングするため、単語が完全一致していなくても意味的に近ければ上位表示されます。

例えば「健康的な食事の方法」という検索に対して、「バランスの取れた食生活のコツ」という記事が評価されるようになります。これは、言葉は異なっても「健康維持のための食事改善」という意味が共通しているためです。

この変化によって、ユーザーはより意図に沿った情報に短時間でアクセスできるようになり、ページ滞在時間やコンバージョン率向上にもつながっています。

変化③|多言語検索の精度向上

BERTは英語クエリから導入されましたが、その構造は多言語にも対応可能です。Googleは英語で学習したモデルを70以上の言語に展開し、異なる言語間でも共通の意味パターンを理解できるようにしました。

その結果、日本語での検索に英語コンテンツが表示されたり、外国語でのクエリにも多言語コンテンツが適切に返されるようになりました。

特に、海外市場をターゲットにするクロスボーダーECサイトや多言語メディアでは、国や言語の壁を越えて情報を届けられるため、SEO戦略の幅が広がります。

変化④|強調スニペットの内容改善

BERTは強調スニペット(Featured Snippets)の抽出精度にも影響を与えています。従来はキーワード一致が重視されていましたが、BERT導入後は文脈の一貫性や情報の網羅性が評価対象に加わりました。

これにより、「Why」「How」といった説明型クエリに対しては、背景や理由まで含んだ内容が表示されやすくなりました。

例えば「なぜ地球は自転しているのか?」という検索では、物理的な理由だけでなく、形成過程や科学的根拠を含む文章がスニペットとして選ばれる可能性が高まっています。

これにより、検索結果ページだけで疑問を解消できるケースが増え、検索体験全体の満足度が向上しています。

BERTアップデートへの対応

BERTの登場によって、SEO戦略は単なるキーワード最適化から、文脈や意図を踏まえた高品質なコンテンツ制作へとシフトしました。検索エンジンがより深く意味を理解するようになったため、サイト運営者は情報の正確性や文章の自然さを重視する必要があります。効果的な対応策は次の4つです。

- 自然で高品質なコンテンツの作成

- ユーザーの検索意図を深く理解する

- 文脈に沿った情報の提供

- 網羅性と信頼性の高い情報

対応①|自然で高品質なコンテンツの作成

BERTは文脈理解を重視するため、機械的にキーワードを詰め込んだ文章や、不自然な構造のテキストは評価されにくくなっています。検索順位を上げるためには、まず読者にとって読みやすく、自然な流れで情報を提供することが欠かせません。

文章は冗長にならないよう整理し、必要な情報を簡潔かつ正確に盛り込みます。また、見出しや段落を適切に分けて論理の流れを明確にすることで、BERTの文脈解析との相性が高まります。

さらに、専門性とわかりやすさを両立させることが重要です。専門用語は必要に応じて説明を補い、初めて読む人でも理解しやすいように工夫します。これにより、検索エンジンからの評価だけでなく、読者満足度の向上にも直結します。

対応②|ユーザーの検索意図を深く理解する

BERTの導入によって、検索クエリは単語の並びや部分一致ではなく、その背景や目的まで解析されるようになりました。コンテンツ制作者はキーワードの表面的な意味だけでなく、検索者が何を知りたいのか、どんな課題を解決したいのかを掘り下げて理解する必要があります。

例えば「ダイエット 食事」という検索は、単なる食事法一覧ではなく、栄養バランス・健康管理・継続のコツなども含めた情報が求められている可能性が高いです。こうした意図を正確に把握するには、共起語分析や関連クエリ調査が有効です。この工程を踏むことで、検索エンジン評価とユーザー満足度を同時に高められます。

対応③|文脈に沿った情報の提供

BERTは単語やフレーズを周囲の文脈に基づいて解釈します。そのため、文章全体で一貫したテーマや論理を維持することが重要です。途中で論点がぶれたり、関連性の低い情報を差し込むと、検索エンジン評価が下がる可能性があります。

重要なキーワードは、文中に不自然にならないよう散りばめます。同時に、関連性を高める補足情報や事例を加えることで、検索エンジンと読者の双方にとって有益なコンテンツになります。これにより、上位表示だけでなく、読者の理解度や信頼感の向上にもつながります。

対応④|網羅性と信頼性の高い情報

BERTは、ユーザーの疑問に最も的確に答えられるコンテンツを高く評価します。そのため、テーマに関する情報を幅広く網羅し、かつ信頼性の高い情報源を基に構成することが必要です。

統計データ、公的機関の発表、専門家の見解などの引用は、記事の信頼性を大きく高めます。また、情報の鮮度を保つために定期的な更新を行うことも不可欠です。こうした網羅性と信頼性の両立は、BERT時代のSEOで長期的に評価される基盤となります。

まとめ

BERTアップデートは、Google検索の文脈理解能力を飛躍的に向上させた歴史的なアルゴリズム変更です。双方向TransformerアーキテクチャやMLM・NSPなどの仕組みにより、検索クエリの意図をより正確に把握し、関連性の高い検索結果を提供できるようになりました。この変化は、英語だけでなく70以上の言語にも波及し、世界規模で検索体験の質を向上させています。

BERT時代のSEOでは、単なるキーワード最適化ではなく、以下の要素が重要になります。

- 自然で高品質な文章構造

- 検索意図に合致した情報設計

- 文脈に沿った一貫性のある記述

- 網羅性と信頼性の確保

これらを満たすコンテンツは、BERTによる評価と親和性が高く、長期的な検索順位の維持にも有利です。もし自社サイトのコンテンツがこれらの基準を満たしているか不安な場合は、専門家によるSEO監査やコンテンツ改善提案を受けることで、BERT時代に適合したサイト運営を実現できます。